Snowflake Cortex LLM-Funktionen werden allgemein verfügbar, mit neuen LLMs, verbessertem Abruf und verstärkter KI-Sicherheit

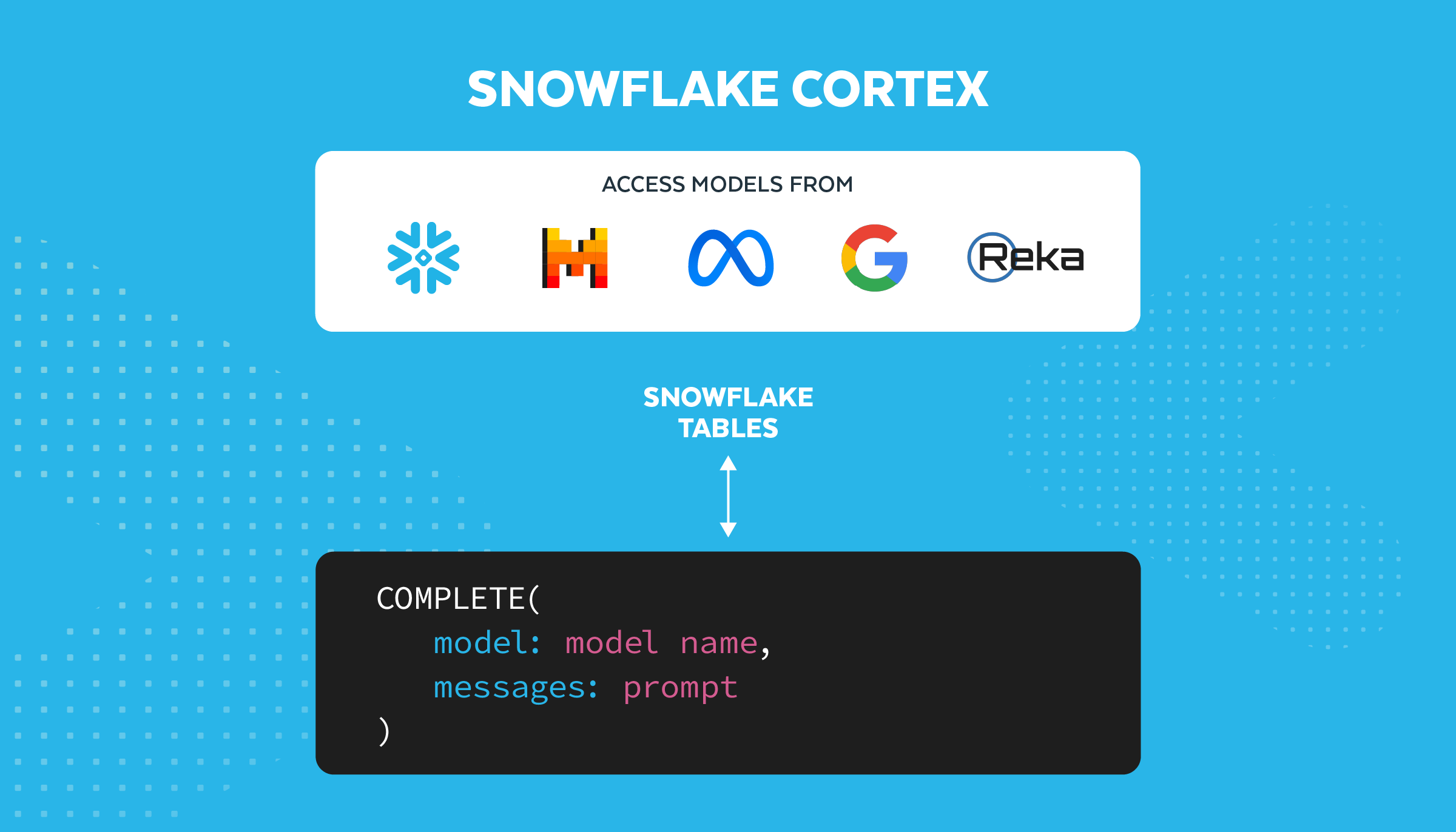

Snowflake Cortex ist ein vollständig verwalteter Dienst, der den Zugriff auf branchenführende Large Language Models (LLMs) ermöglicht, und ist jetzt allgemein verfügbar für Kunden. Sie können diese LLMs in ausgewählten Regionen direkt über LLM-Funktionen auf Cortex verwenden, um generative KI (GenAI) sicher zu Ihren kontrollierten Daten zu bringen. Ihr Team kann sich auf die Entwicklung von KI-Anwendungen konzentrieren, während wir uns um Modelloptimierung und GPU-Infrastruktur kümmern, um kosteneffiziente Performance zu bieten.

Im Folgenden finden Sie die vollständigen Updates, die heute im Rahmen unserer Mission veröffentlicht wurden, effiziente, benutzerfreundliche und zuverlässige generative KI bereitzustellen:

- Weitere leistungsstarke LLMs: Neben leistungsstarken LLMs von Mistral AI und Google unterstützt Cortex jetzt auch Snowflake Arctic, Llama 3 (8B und 70B) und Reka-Core LLMs. All diese Grundlagenmodelle sind über die einfache COMPLETE-Funktion verfügbar – jetzt allgemein verfügbar

- Effiziente RAG und semantische Suche mit Arctic Embed: Embed- und Vektorfunktionen befinden sich jetzt in Public Preview und unterstützen Arctic Embed, das weltweit beste praktische Texteinbettungsmodell für den Abruf.

- Verbesserte KI-Sicherheit mit Llama Guard: Im Rahmen der Zusammenarbeit mit Meta wird Llama Guard, ein LLM-basiertes Input-Output-Safeguard-Modell, nativ in Snowflake Arctic integriert und demnächst für andere Modelle in Cortex LLM Functions verfügbar sein.

Durch die Kombination dieser Updates entsteht weiterer Mehrwert für alle Branchen, insbesondere für zwei bestimmte Anwendungsfälle:

- Textanalyse und -generierung: Eine große Video-Hosting-Plattform hatte aufgrund begrenzter Dateneinblicke aus textbasierten Benutzerinteraktionen damit zu kämpfen, kostenlose Benutzer:innen in bezahlte Abonnements umzuwandeln. Durch die Ausführung semantischer Suchaufgaben mit den Einbettungs- und Vektorabstandsfunktionen konnten Zielsegmente klarer definiert werden. Dann wurden mithilfe von Grundlagenmodellen in der COMPLETE-Funktion personalisierte E-Mails erstellt. Da diese LLM-Vorgänge mühelos als Batch-Vorgänge in Snowflake ausgeführt werden können, führt das Team diese kontinuierlich aus, um die Konversionen von kostenlosen zu bezahlten Abonnements zu steigern.

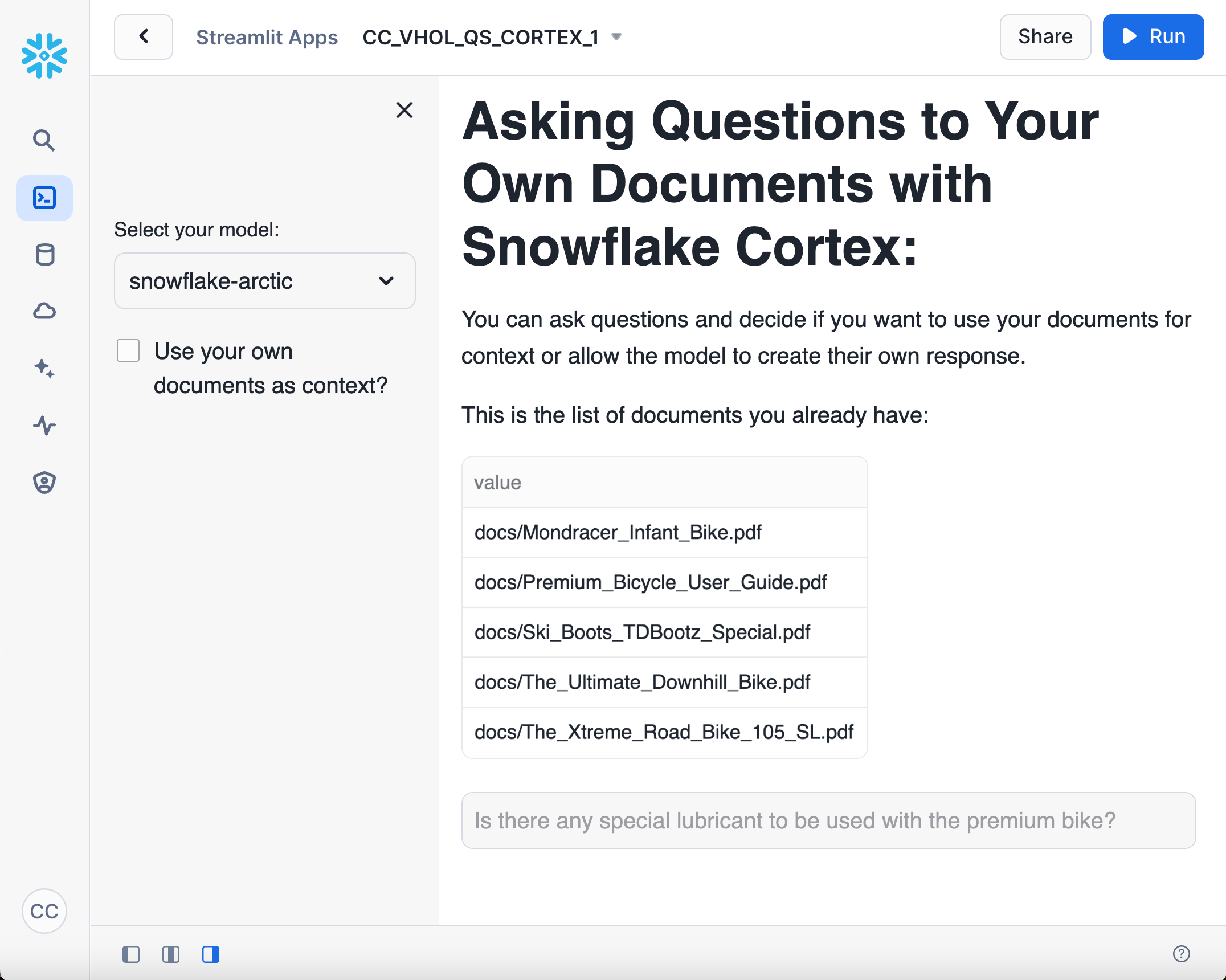

- Dokument-Chatbots Ein multinationales, nachhaltiges Energietechnologieunternehmen hatte Probleme, die Zusammenarbeit zwischen geografisch verteilten technischen Teams effektiv zu ermöglichen. Ihr Wissen war in mehr als 700.000 Seiten privaten Forschungs- und Entwicklungsdokumenten enthalten. Mit einer RAG-basierten Architektur, die Cortex und Streamlit in Snowflake kombiniert, hat das Team einen Dokumenten-Chatbot entwickelt. Diese neue Anwendung optimiert den Wissensaustausch, verkürzt die Zeit für die Informationssuche und steigert die Produktivität insgesamt.

Erweiterte Flexibilität für leistungsstarke LLMs mit Unterstützung für die Modelle Snowflake Arctic, Llama 3 und Reka

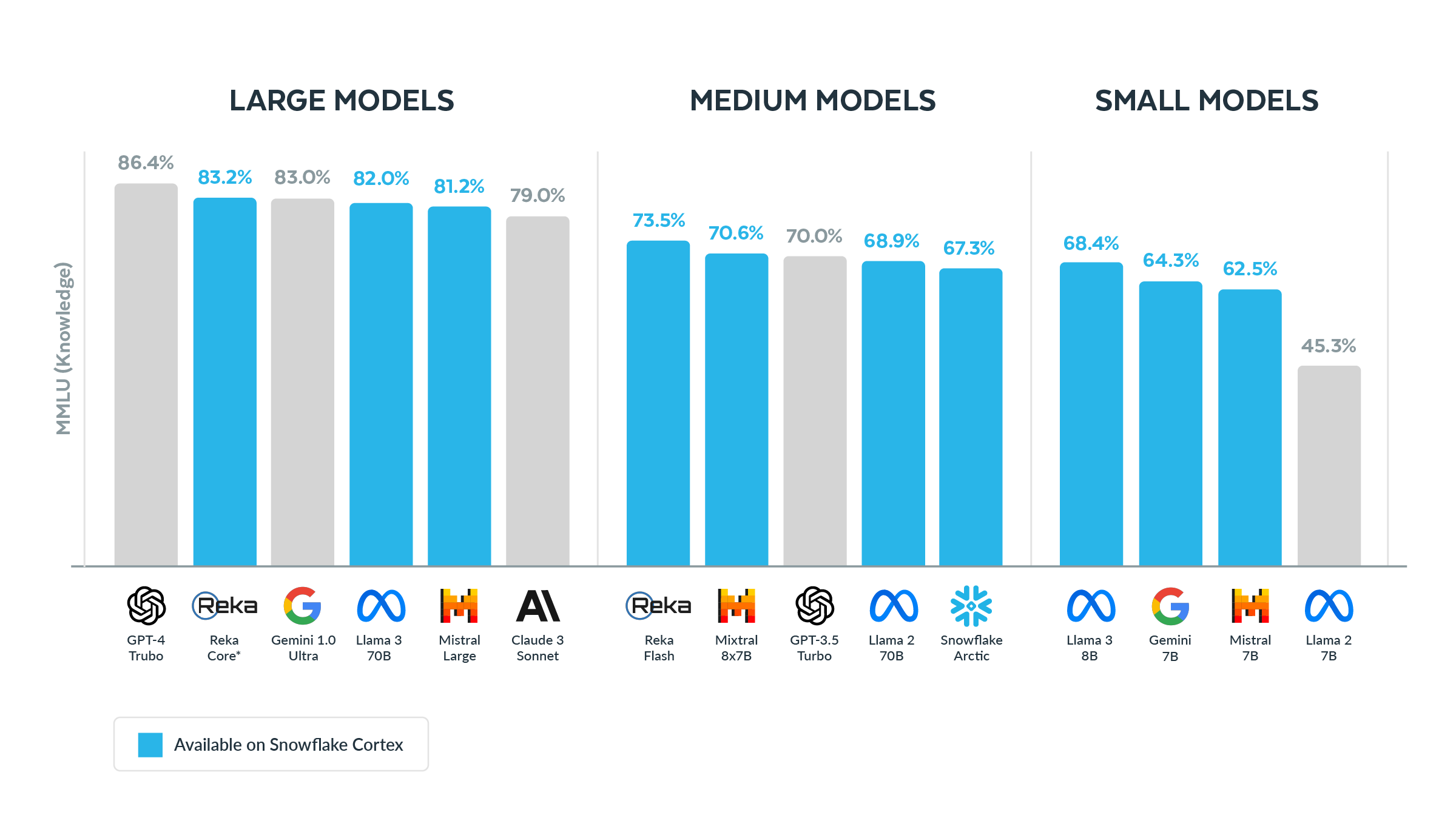

Moderne Modelle entwickeln sich immer weiter. Deshalb benötigen Kunden Flexibilität, um Modelle schnell und sicher zu testen und zu bewerten, und so die besten Ergebnisse für ihren Anwendungsfall zu erhalten. Aus diesem Grund unterstützt Snowflake Cortex nun auch Folgendes:

- Snowflake Arctic: Das effiziente und wirklich offene Modell von Snowflake für Unternehmensaufgaben. Arctic eignet sich hervorragend für Unternehmensaufgaben, wie SQL-Erstellung, Coding und Anweisungsbefolgung. Die Apache-2.0-Lizenz bietet ungehinderten Zugang zu Gewichtungen und Code. Snowflake-Kunden, die eine Zahlungsmethode hinterlegt haben, können noch bis zum 3. Juni 2024 kostenlos auf Snowflake Arctic zugreifen. Es gelten tägliche Limits.

- Meta Llama 3 8B and 70B: Die Llama 3-Modelle sind leistungsstarke Open-Source-Modelle, die bei einer Vielzahl von Aufgaben für die Verarbeitung von natürlicher Sprache überzeugen und mehrere frühere Modelle übertreffen. Diese Modelle bieten verbesserte Funktionen wie logisches Denken, Codegenerierung und Anweisungsbefolgung sowie eine größere Vielfalt bei den Modellantworten.

- Reka Core: Dieses LLM ist ein hochmodernes multimodales Modell, das ein umfassendes Verständnis von Bildern, Videos und Audio sowie Text demonstriert. Derzeit bietet Snowflake Cortex die Textmodalität mit Unterstützung für Multimodal, die in naher Zukunft erwartet wird.

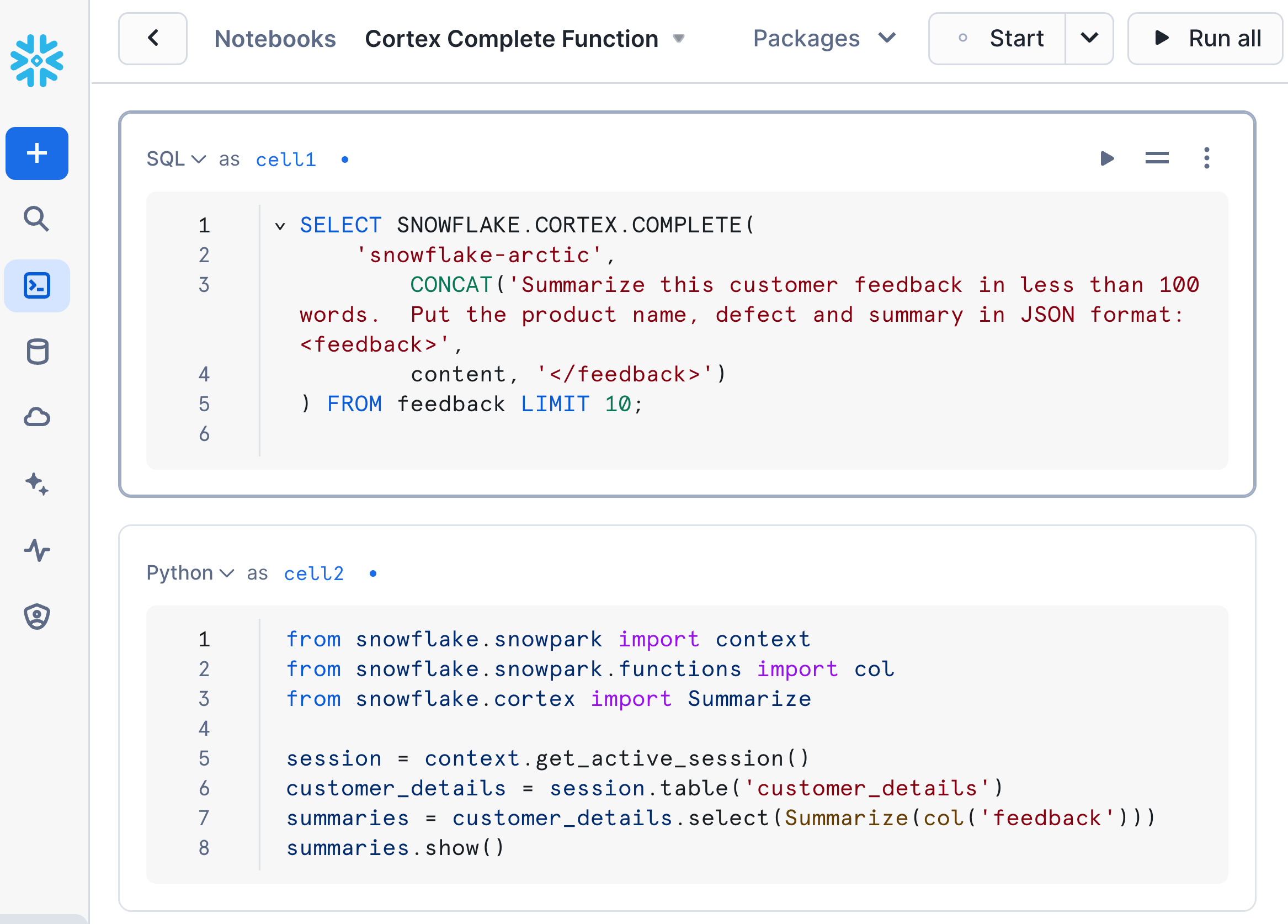

Die Verwendung eines dieser Modelle für Ihre Daten ist so einfach wie das Ändern des Modellnamens in der Funktion COMPLETE, die sowohl in SQL als auch in Python verfügbar ist.

Effiziente RAG und semantische Suche mit Arctic-embed

Um geschäftliche Fragen mithilfe von LLMs genau zu beantworten, müssen Unternehmen vortrainierte Modelle um ihre Daten ergänzen. Retrieval Augmented Generation (RAG) ist eine beliebte Lösung für dieses Problem, da es faktische Echtzeitdaten in die LLM-Erstellung einbezieht.

Snowflake-Kunden können nun mit unserer vollständig integrierten Lösung mühelos RAG-orientierte Anwendungsfälle wie z. B. Dokument-Chat-Erfahrungen testen und bewerten. Arctic Embed ist jetzt als Option in der Cortex EMBED-Funktion verfügbar. Die EMBED- und Vektorabstandsfunktionen sind zusammen mit VECTOR als nativer Datentyp in Snowflake derzeit in Public Preview verfügbar und werden demnächst allgemein verfügbar sein. Da all dies nativ in die Plattform von Snowflake integriert ist, müssen Sie keinen separaten Vektorspeicher einrichten, pflegen und verwalten. Diese kohäsive Erfahrung beschleunigt den Weg von der Idee zur Umsetzung und erweitert die Bandbreite der Anwendungsfälle, die Unternehmen unterstützen können.

Sind Sie bereit, Ihren eigenen Dokumenten-Chatbot in Snowflake zu erstellen? Probieren Sie diesen Schritt-für-Schritt-Quickstart aus.

Wir entwickeln weiterhin fortschrittlichere und effizientere Abfragen, damit Unternehmen sicher mit ihren Daten sprechen können, und zwar auf eine Weise, die offen und kollaborativ ist, um die Branche voranzubringen. Vor diesem Hintergrund haben wir Arctic Embed, das weltweit beste praktische Texteinbettungsmodell für den Abruf, auf Open Source umgestellt und kürzlich eine Partnerschaft mit der Universität Waterloo angekündigt, um die Benchmarks für den Abruf weiterzuentwickeln.

Verbesserte KI-Sicherheit mit Llama Guard in Snowflake Arctic

Bei Snowflake legen wir großen Wert auf die Einhaltung hoher Sicherheitsstandards für GenAI-Anwendungen. Im Rahmen unseres kontinuierlichen Fokus und unserer Partnerschaft mit Meta ist das Llama Guard-Modell nativ in Snowflake Arctic integriert (demnächst auch für andere Modelle verfügbar), um proaktiv potenziell schädliche Inhalte aus LLM-Prompts und -Antworten herauszufiltern. Snowflake Arctic minimiert in Kombination mit Llama Guard unerwünschte Inhalte in GenAI-Anwendungen und sorgt so für eine sicherere Benutzererfahrung für alle. Llama Guard von Meta wurde auf Grundlage des gesammelten Datasets von Meta weisungsgesteuert angepasst. Sie zeigt eine starke Performance bei bestehenden Benchmarks, die der Performance der derzeit verfügbaren Content-Moderationstools gleichkommt oder diese sogar übertrifft. Das Modell kann bestimmte Sicherheitsrisiken in LLM-Prompts erkennen und die Reaktionen klassifizieren, die LLMs auf diese Prompts generieren. Wir wollen unseren Kunden auch die Möglichkeit bieten, Llama Guard bald mit anderen Modellen in Cortex zu verwenden.

Verbesserung der Unternehmens-KI: LLMs basierend auf Sicherheit und Zuverlässigkeit

Datensicherheit ist entscheidend für die Entwicklung produktionsreifer GenAI-Anwendungen. Snowflake hat sich den branchenführenden Standards für Datensicherheit und Datenschutz verschrieben, damit Unternehmenskunden ihr wichtigstes Asset – die Daten – während des gesamten KI-Lebenszyklus schützen können, von der Erfassung bis zur Inferenz. Die hohe Sicherheit gilt für alles in Cortex: Egal, ob eine der aufgabenspezifischen Funktionen wie SUMMARIZE oder ein Foundation-Modell von Snowflake, Mistral AI, Meta oder ein anderes verwendet wird, Folgendes ist immer zutreffend:

- Snowflake verwendet keine Kundendaten, um LLMs zu trainieren, die kundenübergreifend eingesetzt werden können.

- LLMs werden innerhalb von Snowflake ausgeführt. Die Daten verlassen niemals die Grenzen des Snowflake-Dienstes und werden auch nicht mit Drittanbietern geteilt.

- Rollenbasierte Zugriffskontrollen (RBAC, Role Based Access Controls) können verwendet werden, um den Zugriff auf Cortex LLM-Funktionen zu verwalten.

Weitere Details finden Sie in unseren FAQ zu AI Trust and Safety und in unserem Whitepaper zum AI Security Framework.

Preisoptionen und Verfügbarkeit

Bei Snowflake Cortex LLM-Funktionen entstehen Rechenkosten, die auf der Anzahl der verarbeiteten Token basieren. Die Kosten für die einzelnen Funktionen in Credits pro Million Token entnehmen Sie der Consumption Table. Die Funktionen sind in ausgewählten Regionen verfügbar. Weitere Details finden Sie in der Matrix zu den Funktionen für die verschiedenen Regionen.

Erste Schritte

Snowflake Cortex ermöglicht es Unternehmen, GenAI-Anwendungen mit LLMs schneller bereitzustellen und dabei ihre Daten im Sicherheits- und Governance-Perimeter von Snowflake zu halten. Probieren Sie es selbst aus!

- Erstellen Sie eine NLP-App (Natural Language Processing)

- Erstellen Sie einen Dokumenten-Chatbot mit RAG

Möchten Sie sich mit Gleichgesinnten vernetzen und von anderen Branchen- und Snowflake-Expert:innen erfahren, wie Sie die neuesten GenAI-Funktionen nutzen können? Seien Sie vom 2. bis 5. Juni beim Snowflake Data Cloud Summit in San Francisco dabei.