Les fonctions LLM de Snowflake Cortex sont disponibles pour tous nos clients avec de nouveaux LLM, une récupération améliorée et une sécurité renforcée de l’IA

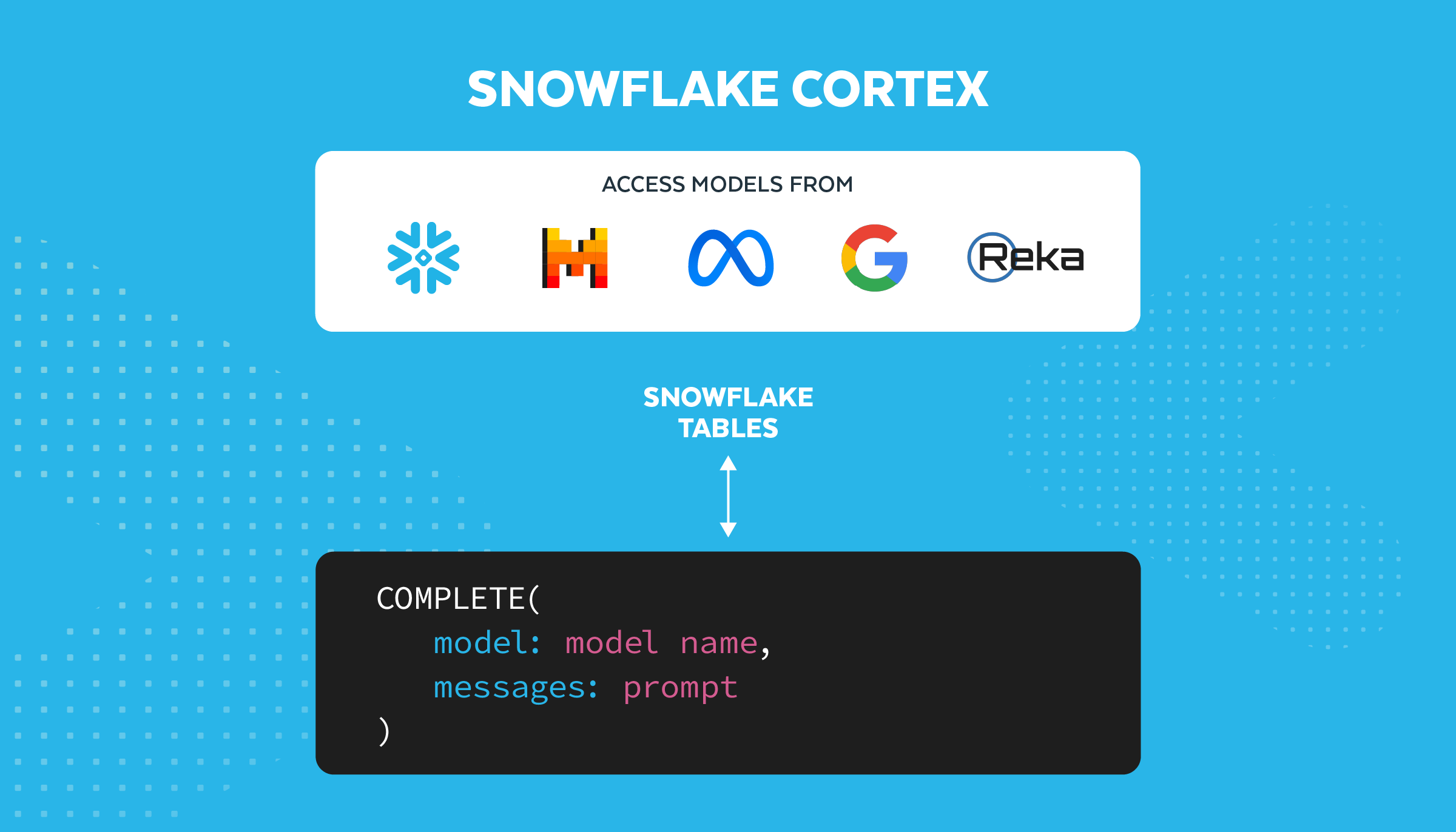

Snowflake Cortex, un service entièrement géré qui permet d’accéder à des grands modèles de langage (LLM) à la pointe du secteur, est maintenant disponible pour tous nos clients. Vous pouvez utiliser ces LLM dans certaines régions directement via les fonctions LLM sur Cortex afin d’intégrer l’IA générative en toute sécurité à vos données gouvernées. Votre équipe peut se concentrer sur le développement d’applications d’IA, tandis que nous gérons l’optimisation des modèles et l’infrastructure GPU pour fournir des performances rentables.

Voici l’ensemble complet des mises à jour publiées aujourd’hui dans le cadre de notre mission visant à fournir une IA générative efficace, conviviale et fiable :

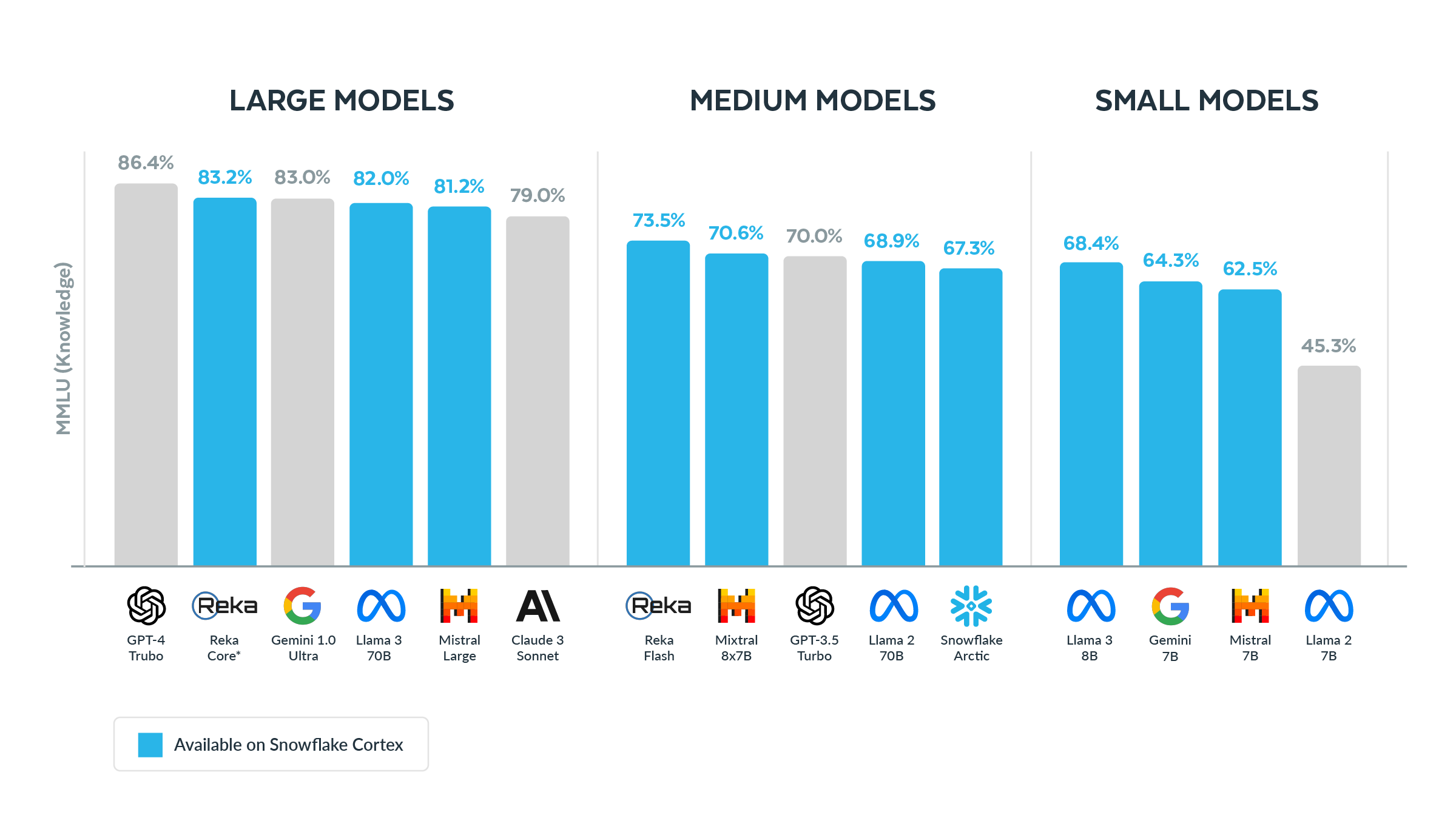

- Plus de LLM hautes performances : outre les LLM hautes performances de Mistral AI et Google, Cortex prend désormais également en charge Snowflake Arctic, Llama 3 (tous deux 8B et 70B) et les LLM Reka-Core. Tous ces modèles de fondation sont disponibles via la fonction COMPLETE unique et facile à utiliser, désormais disponible pour tous nos clients.

- RAG et recherche sémantique efficaces avec Arctic Embed : les fonctions vectorielles et Embed sont maintenant en public preview et incluent la prise en charge d’Arctic Embed, un excellent modèle d’intégration de texte pour la récupération.

- Une sécurité d’IA renforcée avec Llama Guard : dans le cadre d’une collaboration avec Meta, Llama Guard, un modèle de sauvegarde d’entrées-sorties basé sur des LLM, est intégré nativement à Snowflake Arctic et sera bientôt disponible pour d’autres modèles dans les fonctions LLM Cortex.

La combinaison de ces mises à jour continue de générer de la valeur dans tous les secteurs, avec deux cas d’usage en particulier :

- Analyse et génération de texte : une grande plateforme d’hébergement vidéo rencontrait des difficultés pour convertir des utilisateurs gratuits en abonnements payants en raison des informations limitées sur les données provenant de ses interactions textuelles avec les utilisateurs. En exécutant des tâches de recherche sémantique avec les fonctions d’intégration et de distance vectorielle, elle a pu définir plus clairement les segments cibles. Ensuite, en utilisant des modèles de fondation dans la fonction Complete, elle a créé des e-mails personnalisés. Comme ces opérations de LLM peuvent s’exécuter facilement par batch dans Snowflake, l’équipe exécute cette opération en permanence pour augmenter le nombre de conversions d’utilisateurs gratuits en abonnements payants.

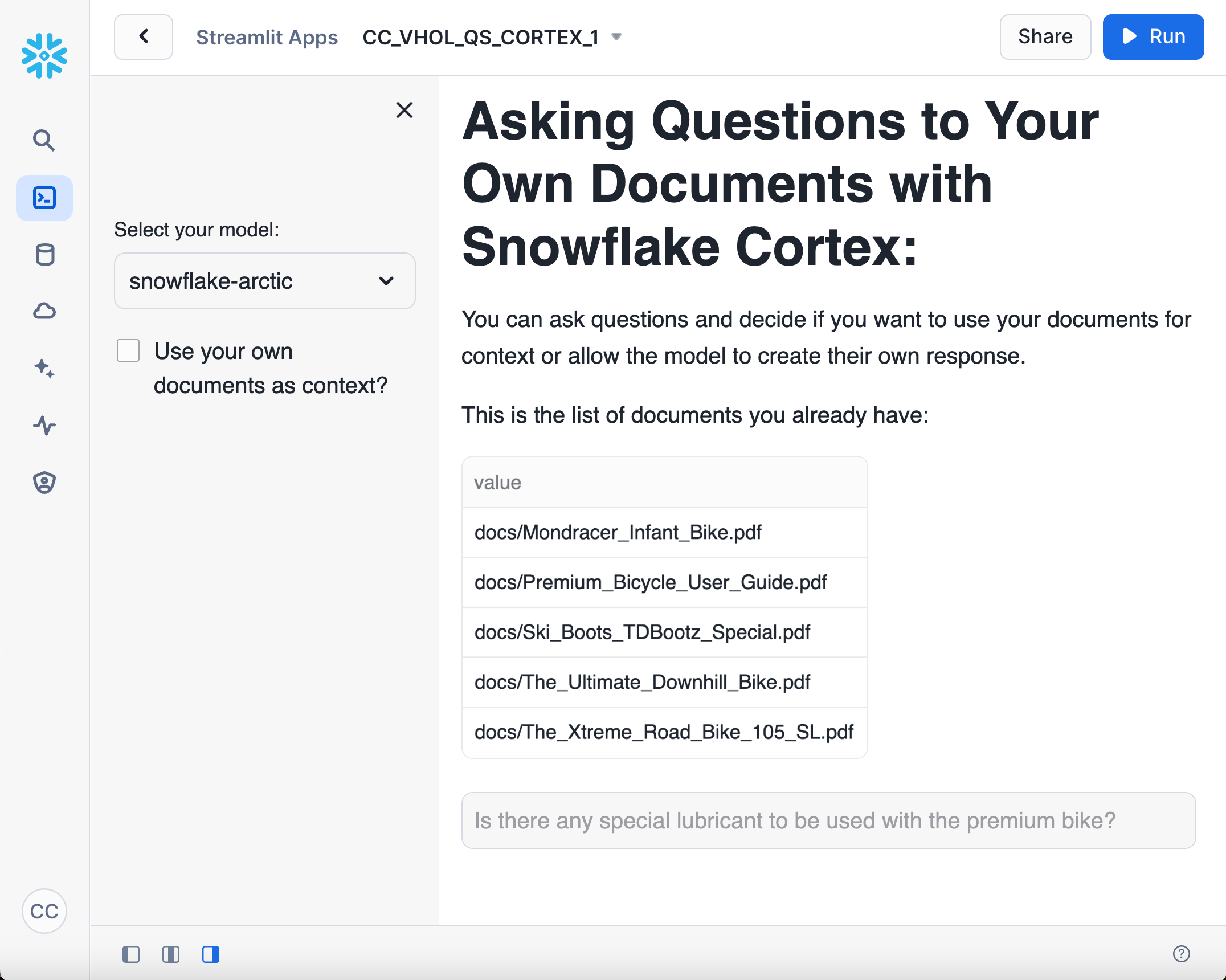

- Chatbots documentaires : une multinationale spécialisée dans les technologies énergétiques durables avait du mal à favoriser efficacement la collaboration entre les équipes techniques réparties géographiquement. Leurs connaissances étaient contenues dans plus de 700 000 pages de documents privés de R&D. En utilisant une architecture basée sur la RAG qui combine Cortex et Streamlit in Snowflake, l’équipe a créé un chatbot documentaire. Cette nouvelle application rationalise le partage des connaissances, réduit le temps de recherche d’informations et augmente la productivité globale.

Flexibilité étendue pour les LLM hautes performances avec prise en charge des modèles Snowflake Arctic, Llama 3 et Reka

Alors que les modèles de pointe continuent d’évoluer, les clients ont besoin de flexibilité pour tester et évaluer rapidement et en toute sécurité les modèles afin d’obtenir les meilleurs résultats pour leur cas d’usage. C’est pourquoi Snowflake Cortex ajoute la prise en charge de :

- Snowflake Arctic : le modèle efficace et véritablement ouvert de Snowflake pour les tâches d'entreprise. Arctic excelle dans les tâches d’entreprise, telles que la production de SQL, le codage et le suivi d’instructions. Disponible sous licence Apache 2.0, il donne accès aux pondérations et au code. Les clients Snowflake disposant d’un mode de paiement enregistré auront accès à Snowflake Arctic gratuitement jusqu’au 3 juin 2024. Offre soumise à des plafonds quotidiens.

- Meta Llama 3 8B et 70B : les Llama 3 sont des modèles open source puissants qui démontrent des performances impressionnantes sur un large éventail de tâches de traitement du langage naturel, surclassant plusieurs modèles de pointe antérieurs. Ces modèles offrent des capacités améliorées, telles que le raisonnement, la génération de code et le suivi d’instructions, ainsi qu’une plus grande diversité des réponses des modèles.

- Reka Core : ce LLM est un modèle multimodal de pointe qui démontre une compréhension complète des images, des vidéos et du son, ainsi que du texte. Actuellement, Snowflake Cortex fournit la modalité textuelle. Une prise en charge multimodale est prévue dans un avenir proche.

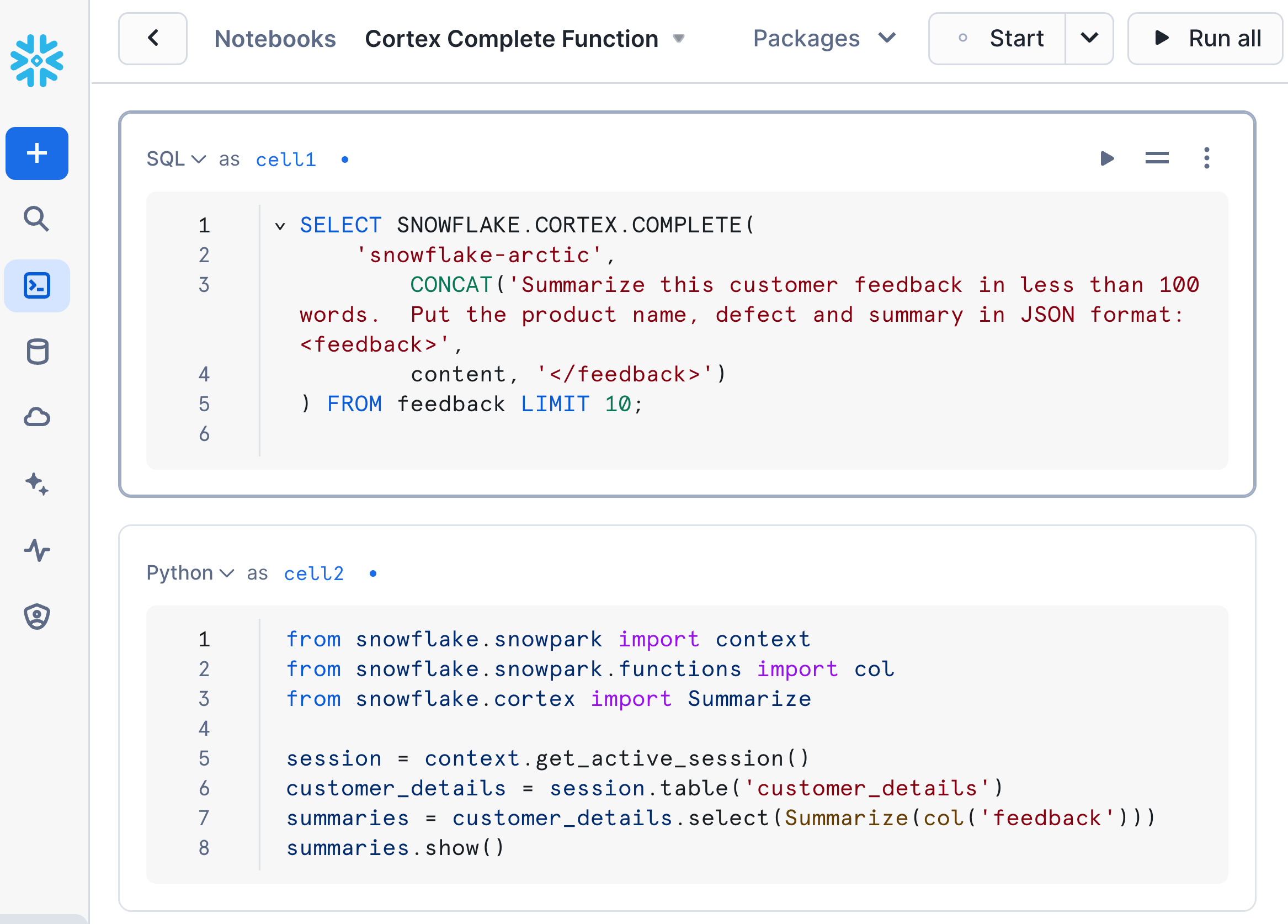

Utiliser l’un de ces modèles avec vos données est aussi simple que de changer le nom du modèle dans la fonction COMPLETE, disponible à la fois en SQL et en Python.

Recherche sémantique et RAG efficaces avec Artic Embed

Pour répondre avec précision aux questions commerciales à l’aide de LLM, les entreprises doivent augmenter les modèles pré-entraînés avec leurs données. La génération augmentée de récupération (RAG) est une solution populaire pour résoudre ce problème, car elle incorpore des données factuelles en temps réel dans la génération de LLM.

Grâce à notre solution entièrement intégrée, les clients Snowflake peuvent désormais tester et évaluer facilement les cas d’usage orientés RAG, tels que les expériences de chat documentaire. Arctic Embed est désormais disponible en option dans la fonction Cortex EMBED. Les fonctions distance vectorielle et EMBED, ainsi que VECTOR, en tant que type de données natif dans Snowflake sont actuellement disponibles en public preview et bientôt disponibles pour tous nos clients. Tout cela étant intégré nativement à la plateforme Snowflake, il n’est pas nécessaire de mettre en place, de gérer et de gouverner un magasin vectoriel séparé. Cette expérience cohérente accélère le parcours de l’idée à la mise en œuvre et élargit l’éventail des cas d’usage que les entreprises peuvent prendre en charge.

Vous êtes prêt à créer votre propre chatbot documentaire dans Snowflake ? Essayez ce guide quickstart étape par étape.

Nous continuons à développer une récupération plus avancée et plus efficace afin que les entreprises puissent consulter leurs données en toute sécurité, et ce de manière ouverte et collaborative pour faire avancer le secteur. Forts de cette approche, nous avons mis en libre accès Arctic Embed, le meilleur modèle d’intégration de texte au monde pour la récupération. Nous avons récemment annoncé un partenariat avec l’Université de Waterloo pour continuer à faire évoluer les benchmarks de récupération.

Sécurité de l’IA renforcée avec Llama Guard dans Snowflake Arctic

Chez Snowflake, nous privilégions le maintien de normes de sécurité élevées pour les applications d’IA générative. Dans le cadre de notre partenariat permanent avec Meta, le modèle Llama Guard est intégré nativement dans Snowflake Arctic (et bientôt disponible pour d’autres modèles) afin de filtrer de manière proactive tout contenu potentiellement préjudiciable des prompts et des réponses des LLM. Snowflake Arctic, associé à Llama Guard, réduit le contenu répréhensible dans vos applications d’IA générative, assurant ainsi une expérience utilisateur plus sécurisée pour tous. Llama Guard de Meta a été réglé sur la base du jeu de données recueillies par Meta. Il démontre de solides performances par rapport aux benchmarks existants, égalant, voire dépassant, les performances des outils de modération de contenu actuellement disponibles. Le modèle peut identifier un ensemble spécifique de risques de sécurité dans les prompts des LLM et classer les réponses générées par les LLM à ces prompts. Nous prévoyons également d’offrir prochainement à nos clients la possibilité d’utiliser Llama Guard avec d’autres modèles dans Cortex.

Accélérer l’IA d’entreprise avec des LLM sûrs et dignes de confiance

La sécurité des données est essentielle au développement d’applications d’IA générative de production. Snowflake s’engage à respecter les normes de confidentialité et de sécurité des données les plus importantes du secteur afin de permettre aux entreprises de protéger leur actif le plus précieux, les données, tout au long de leur parcours de vie dans le cycle de l’IA, de l’ingestion à l’inférence. Le niveau de sécurité élevé peut être appliqué à tout Cortex ; que ce soit à l’aide d’une des fonctions spécifiques à une tâche, comme summarize, ou d’un modèle de fondation de Snowflake, Mistral AI, Meta ou autre, ce qui suit est toujours vrai :

- Snowflake n’utilise pas de données clients pour entraîner des LLM qui seront utilisés par ses clients.

- Les LLM s’exécutent dans Snowflake. Les données ne quittent jamais les limites du service Snowflake et ne sont jamais partagées avec un fournisseur tiers.

- Les contrôles d'accès basés sur les rôles (RBAC) peuvent être utilisés pour gérer l'accès aux fonctions LLM de Cortex.

Vous trouverez plus de détails dans notre FAQ sur la confiance en l’IA et sa sécurité et notre livre blanc AI Security Framework.

Tarifs et disponibilité

Les fonctions LLM de Snowflake Cortex entraînent des coûts de calcul, en fonction du nombre de tokens traités. Consultez le tableau de consommation pour connaître le coût de chaque fonction en crédits par million de tokens. Cette fonctionnalité est disponible dans certaines régions. Reportez-vous à la matrice des fonctionnalités par région pour plus de détails.

Premiers pas

Snowflake Cortex permet aux entreprises d’accélérer la livraison d’applications d’IA générative avec des LLM tout en conservant leurs données dans le périmètre de sécurité et de gouvernance de Snowflake. Essayez vous-même !

Vous voulez échanger avec vos pairs et découvrir comment utiliser les dernières fonctionnalités d’IA générative avec d’autres experts du secteur et Snowflake ? Rejoignez-nous au Snowflake Data Cloud Summit à San Francisco du 3 au 6 juin.