DeepSeek-R1 ora in preview su Snowflake Cortex AI

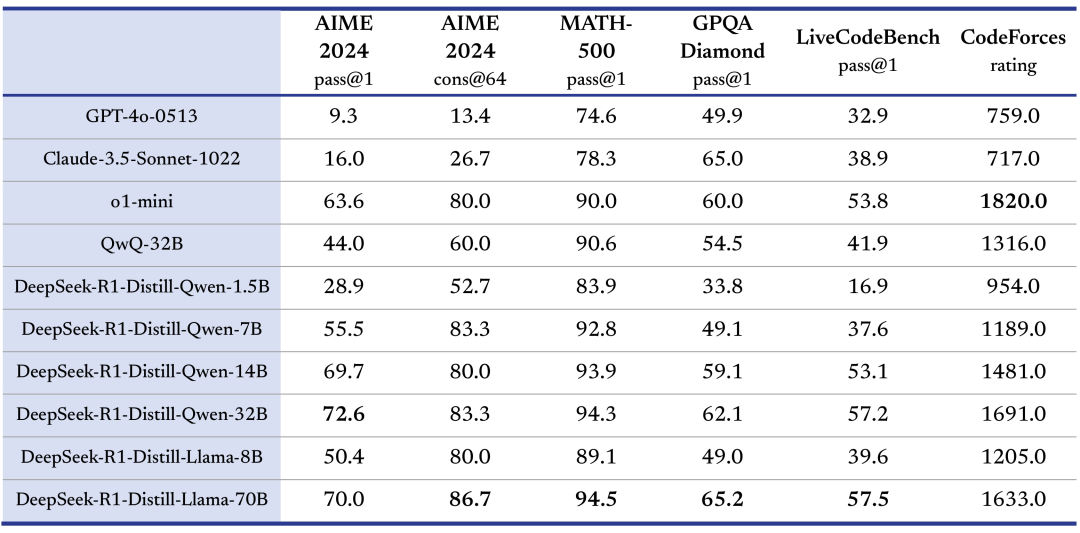

Siamo entusiasti di portare DeepSeek-R1 su Snowflake Cortex AI! Come descritto da DeepSeek, questo modello, addestrato tramite Reinforcement Learning (RL) su larga scala senza fine‐tuning supervisionato (SFT), può raggiungere prestazioni paragonabili a OpenAI‐o1 per task matematici, di coding e di ragionamento. In base al benchmark pubblicato da DeepSeek, DeepSeek-R1 è in cima alla classifica dei modelli open source e compete con i modelli closed source più avanzati a livello globale. I clienti possono ora richiedere una early preview di DeepSeek-R1 su Cortex AI.

Nell’ambito della private preview, ci concentreremo sul fornire un accesso in linea con i nostri principi di semplicità, efficienza e fiducia.

Il modello è disponibile in private preview per l’inferenza serverless sia in batch (funzione SQL) che interattiva (Python e API REST). Per richiedere l’accesso durante la preview, contatta il tuo team di vendita. Il modello sarà disponibile solo nell’account che lo ha richiesto.

Il modello è ospitato negli Stati Uniti entro i confini del servizio Snowflake. Non condividiamo i dati con il provider del modello.

Una volta che il modello sarà in GA, i clienti possono gestire l’accesso al modello tramite il controllo degli accessi basato sui ruoli (RBAC). Gli amministratori degli account possono limitare l’accesso selezionando i modelli approvati in base ai criteri di governance.

Snowflake Cortex AI

Snowflake ha lanciato Cortex AI, una suite di funzionalità e servizi integrati che includono inferenza LLM completamente gestita, fine-tuning e RAG per i dati strutturati e non strutturati, per consentire ai clienti di analizzare rapidamente i dati non strutturati insieme ai propri dati strutturati e accelerare la creazione di app AI. I clienti possono accedere a LLM leader di settore, sia open source che proprietari, e integrarli facilmente nei propri flussi di lavoro e applicazioni. Snowflake ha adottato l’ecosistema open source con il supporto di più LLM di Meta, Mistral e Snowflake. Riteniamo che questo accesso aperto e questa collaborazione prepareranno la strada a un’innovazione accelerata in questo settore.

DeepSeek-R1

Su GitHub, DeepSeek ha spiegato di aver applicato direttamente il Reinforcement Learning (RL) al modello di base senza affidarsi al fine-tuning supervisionato (SFT) come fase preliminare. Questo approccio ha consentito al modello di esplorare il chain-of-thought (CoT) per risolvere problemi complessi, sviluppando così DeepSeek-R1-Zero. Menzionano inoltre il fatto che il modello iniziale dimostrava capacità di autoverifica, riflessione e generazione di lunghi CoT, ma affrontava sfide come ripetizione infinita, scarsa leggibilità e interferenze tra lingue. Per risolvere questi problemi, il team DeepSeek spiega in che modo ha incorporato i dati cold-start prima dell’RL per migliorare le prestazioni di ragionamento.

Il team ha implementato un addestramento FP8 a bassa precisione e una strategia Auxiliary-Loss-Free Load Balancing, ottenendo prestazioni all’avanguardia con costi di calcolo per il training significativamente ridotti.

Utilizzare DeepSeek-R1 in Cortex AI

Con Snowflake Cortex AI, accedere ai large language model (LLM) è facile. Non è necessario gestire integrazioni o chiavi API. I controlli di governance possono essere implementati in modo coerente su dati e AI. È possibile accedere ai modelli in una delle regioni supportate. Inoltre, puoi accedere da altre regioni con l’inferenza cross-region abilitata. Puoi abilitare Cortex Guard per filtrare le risposte potenzialmente inappropriate o non sicure. I guardrail rafforzano la governance applicando policy allineate per filtrare i contenuti dannosi.

SQL e Python

Il modello può essere integrato in una pipeline di dati o in un’app Streamlit in Snowflake per elaborare più righe in una tabella. Per questa integrazione è possibile utilizzare la funzione COMPLETE, accessibile sia in SQL che in Python. All’interno della funzione COMPLETE di Cortex AI, utilizzata per le applicazioni di inferenza LLM, è sufficiente aggiungere “guardrails: true” per filtrare i contenuti dannosi. Inoltre puoi accedere ai modelli DeepSeek da un notebook Snowflake o dal tuo IDE preferito utilizzando OAuth per client personalizzati. Accedi qui ad altri modelli e dettagli su come utilizzare la funzione SQL oppure scopri qui la sintassi di Python.

SELECT SNOWFLAKE.CORTEX.COMPLETE('deepseek-r1',

[{'content': CONCAT('Summarize this customer feedback in bullet points:<feedback>', content ,'</feedback>')}],

{'guardrails': true}

);

Una volta attivato Cortex Guard, le risposte del modello linguistico associate a contenuti dannosi, come crimini violenti, odio, contenuti sessuali, autolesionismo e altro, saranno automaticamente filtrate e il modello restituirà un messaggio “Risposta filtrata da Cortex Guard”. Per maggiori informazioni sul punto di vista di Snowflake sulla sicurezza dell’AI, leggi il nostro white paper sull’AI Security Framework.

API REST

Per consentire ai servizi o alle applicazioni eseguiti all’esterno di Snowflake di effettuare chiamate di inferenza a bassa latenza verso Cortex AI, l’interfaccia API REST è la strada giusta. Ecco un esempio di come funziona:

curl -X POST \

"model": "deepseek-r1",

"messages": [{ "content": "Summarize this customer feedback in bullet points: <feedback>”}],

"top_p": 0,

"temperature": 0.6,

}' \

https://<account_identifier>.snowflakecomputing.com/api/v2/cortex/inference:complete

Prossime fasi

Per DeepSeek, questo è il primo modello open source a dimostrare che le capacità di ragionamento dei LLM possono essere incentivate esclusivamente tramite RL, senza la necessità di SFT. Cortex AI fornisce una facile integrazione tramite funzioni SQL e API REST, mentre Cortex Guard consente ai clienti di implementare i controlli di sicurezza necessari. Il team di ricerca sull’AI Snowflake prevede di potenziare DeepSeek-R1 per ridurre ulteriormente i costi di inferenza. I clienti possono ottenere un'efficienza costo-prestazioni ottimale con DeepSeek-R1 e accelerare la distribuzione di applicazioni Gen AI. Questa svolta apre la strada ai progressi futuri in quest’area.

Nota: questo articolo contiene delle affermazioni riferite al futuro, tra cui offerte future di prodotti, che però non rappresentano un impegno a fornire alcuna offerta di prodotti. Le offerte e i risultati effettivi potrebbero essere diversi ed essere soggetti a incertezze e rischi noti e non noti. Fai riferimento al nostro più recente modulo 10‑Q per ulteriori informazioni.